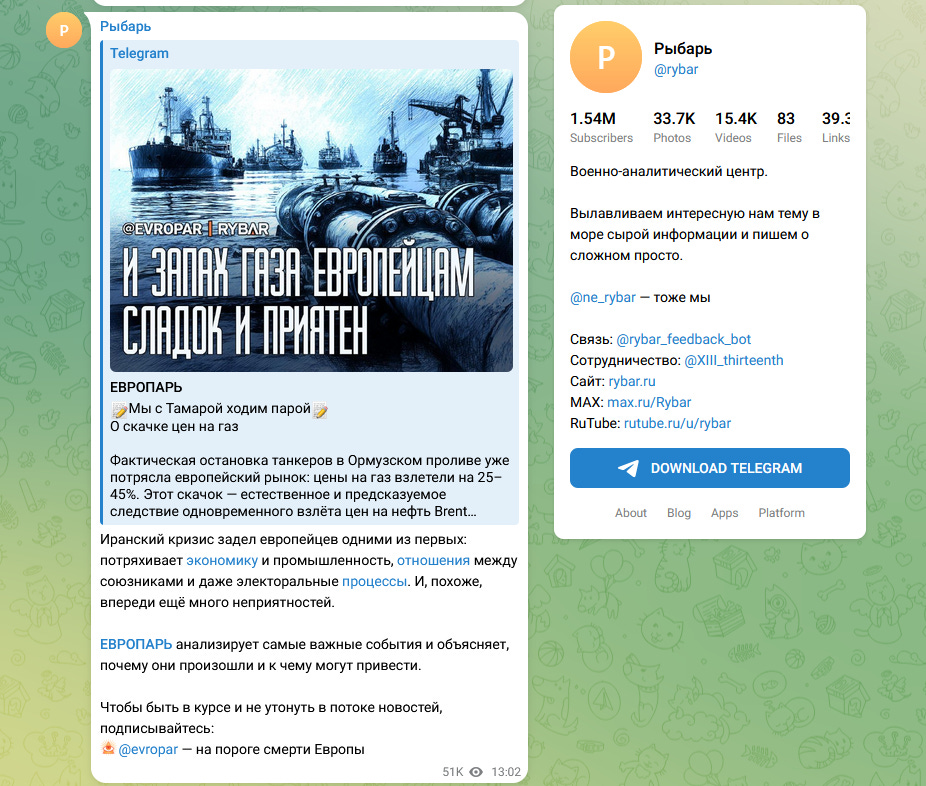

„Рыбарь“ и ChatGPT

OpenAI разкри системна руска операция за дезинформация

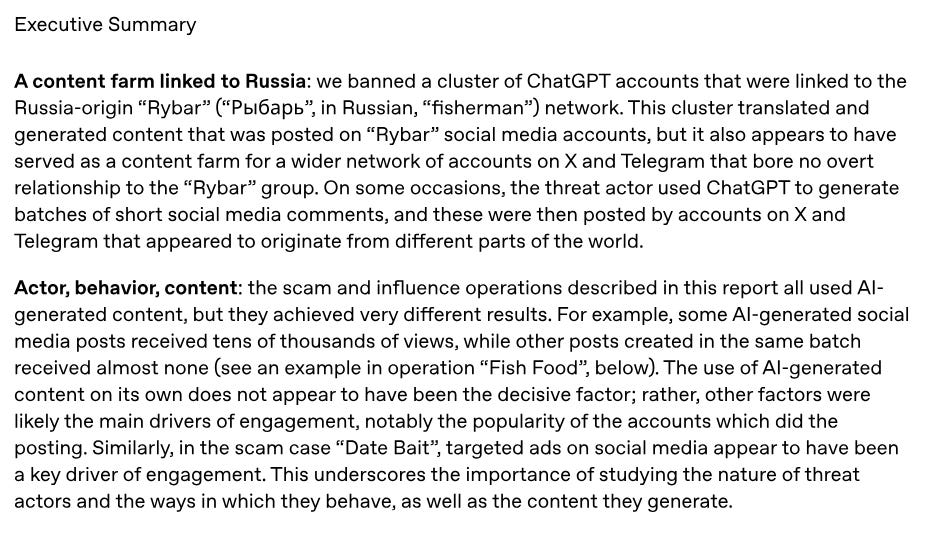

Миналата седмица светът на изкуствения интелект стана свидетел на поредното предупреждение за тъмната страна на технологиите. OpenAI блокира акаунти на руска дезинформационна мрежа, свързана с телеграм‑канала „Рыбарь“, след като бе установено, че организацията използва ChatGPT не само за създаване на съдържание, но и за планиране и координация на манипулативни кампании в различни части на света.1 Това не е просто случайна злоупотреба: става дума за системна стратегия за разпространение на дезинформация, насочена към Африка и франкоезични медии, която комбинира онлайн операции с действия на терен.

Освен генерирането на съобщения, основният акаунт на мрежата е използвал ChatGPT за планиране и самореклама, а именно за, забележете2:

превод на английски на списъка с услуги на „Рыбарь“, включително администриране на акаунти в X и Telegram и водене на сайт за „разследваща журналистика“ с фокус върху Африка;

договаряне на платени публикации във франкоезични медии и развитие на мрежата от разпространители на тези материали;

редакция на предложение за командировка на екип за намеса в избори в Африка, чиято дейност би комбинирала работа в интернет и на терен и, по‑специално, предполага развитие на мрежа от местни агенти и организация на мащабни събития;

обсъждане на информационна кампания, чиято цел е Демократическата република Конго;

въпроси относно изборните процеси в Бурунди и Камерун;

определяне на възможни варианти за кампания в Мадагаскар, включително предизвикване на протести на място (в OpenAI отбелязват, че най-амбициозната идея е предполагала годишен бюджет до 600 хиляди долара).

Докладът на OpenAI „Disrupting Malicious Uses of AI“ описва подробно как компанията идентифицира подобни злонамерени операции и как блокира достъпа до своите модели. Целта е да се предотвратят не само измами и спам, но и координирани кампании за влияние, които могат да променят общественото мнение и да застрашат изборни процеси. Системите за мониторинг на OpenAI следят аномалии и подозрителни модели на активност, а при установяване на злоупотреба компанията споделя технически индикатори с други технологични платформи, за да предотврати разпространението на вредното съдържание.

Дори ако мрежата „Рыбарь“ ( тя включва видеоканал, сайтове и профили в социални мрежи) се опита да създаде нови акаунти в ChatGPT, шансовете да остане незабелязана са минимални, казват от американската компанията. OpenAI разчита на комбинация от технически индикатори и анализ на поведенчески модели – включително стил на писане, структура на диалозите, честота и времеви модели на активност. Дори при използване на различни устройства или VPN, системите могат да засекат сходства и повторение на типични операции, докато обменът на информация с други платформи увеличава вероятността същите злоупотребяващи мрежи да бъдат блокирани повторно. Просто създаване на нов акаунт без промяна на тактиката и стратегията няма да предотврати разобличаването и ограничаването на достъпа.

Случаят със „Рыбарь“ показва една от най‑опасните страни на модерния AI: колко лесно инструментите, предназначени за творчество и помощ, могат да бъдат използвани за системно манипулиране на информация и влияние върху цели региони. В същото време реакцията на OpenAI демонстрира стремежа на индустрията към прозрачност, отговорност и активна защита срещу злоупотреби, които могат да имат реални геополитически последици.

фон Даниц

https://www.stopfake.org/ru/openai-zablokirovala-rossijskuyu-set-rybar-ispolzovavshuyu-chatgpt-dlya-fejkov/

https://cdn.openai.com/pdf/df438d70-e3fe-4a6c-a403-ff632def8f79/disrupting-malicious-uses-of-ai.pdf